楽天、新たに2つのAIモデルを発表 日本語に最適化した「Rakuten AI 2.0」と初の小規模言語モデル「Rakuten AI 2.0 mini」が登場

楽天グループは、Mixture of Experts(MoE)アーキテクチャを採用した新しい日本語大規模言語モデル(以下、LLM)「Rakuten AI 2.0」と、楽天初の小規模言語モデル(以下、SLM)「Rakuten AI 2.0 mini」の2つのAIモデルを発表した。

両モデルは、AIアプリケーションを開発する企業や技術者などの専門家を支援することを目指しているとし、来春を目途にオープンソースコミュニティに向けて公開予定とのことだ。

「Rakuten AI 2.0」は、2024年3月に公開した日本語に最適化した高性能なLLMの基盤モデル「Rakuten AI 7B」を基に開発した8x7BのMoE基盤モデル。

同LLMは、8つの70億パラメータで構築した「エキスパート」と呼ばれるサブモデルで構成され、トークンはルーターによって選定された最も適した2つの「エキスパート」に処理されるという。

それぞれの「エキスパート」とルーターは共に高品質な日本語と英語の言語データを用いた継続的な学習が行われている。

また、楽天が初めて開発したSLM「Rakuten AI 2.0 mini」は、15億パラメータの基盤モデル。

同SLMは、内製の多段階データフィルタリング、アノテーションプロセスを通じてキュレーションおよびクリーンアップされた広範な日本語と英語のデータセットで最初から学習されており、テキスト生成において高性能かつ高精度な処理を実現しているという。

■「Rakuten AI 2.0」:高効率な先進モデル構築

「Rakuten AI 2.0」は、入力トークンに対して最も関連性の高い「エキスパート」を動的に選択する高度なMoEアーキテクチャを採用し、計算効率と性能を最適化。同LLMは、8倍規模の高密度モデルに匹敵する性能を発揮するが、消費計算量においては1/4程度に抑えることが可能となっている。

●パフォーマンス向上

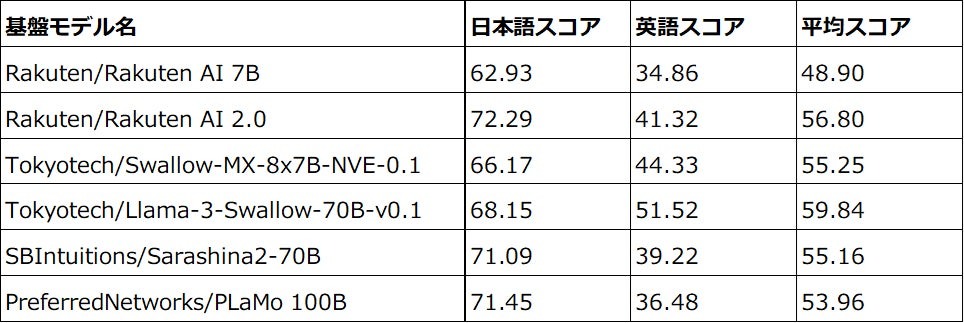

楽天は、LM-Harnessを使用して日本語と英語の能力測定を行うモデル評価を実施。リーダーボードは、対象言語の特性を反映した広範な自然言語処理および理解タスクに基づいて言語モデルを評価しており、「Rakuten AI 2.0」の平均日本語性能は「Rakuten AI 7B」と比較して8つのタスクで62.93から72.29に向上。

■「Rakuten AI 2.0 mini」:実用的なアプリケーション向けのコンパクトかつ効率的なモデル

同SLMは、コンパクトなモデルのためモバイル端末に導入でき、データをリモートサーバーに送信することなく自社運用することが可能に。汎用アプリケーションに使用される大規模モデルと比べ、SLMはプライバシーの保護、低遅延、コスト効率が求められる特定のアプリケーションに適した形で活用可能となる。

楽天は、最新のLLMおよびSLMをオープンなモデルとして提供することで、オープンソースコミュニティへの貢献を目指すと共に日本語LLMのさらなる発展に寄与するという。同社で最新のLLMモデルの開発を継続することで知見やノウハウを蓄積し「楽天エコシステム(経済圏)」の拡大に取り組むとのことだ。